Wd提问: 压缩ai安装包

Ai批改: 压缩 AI 安装包通常指的是减小 AI 模型或与其相关的软件安装包的大小,以便于存储、传输或部署。以下是一些压缩 AI 安装包的常见方法:

1、模型剪枝(Model Pruning)

模型剪枝是一种通过去除模型中不重要的权重或神经元来减小模型大小的技术。这种方法可以显著减少模型的存储需求和计算需求,而不会明显影响模型的性能。

2、量化(Quantization)

量化是指将模型的权重和激活值从浮点数转换为整数的过程。这样可以显著减少模型的内存占用和计算资源需求,因为整数运算比浮点运算更高效,内存使用率更低。

3、知识蒸馏(Knowledge Distillation)

知识蒸馏是一种技术,训练一个较小的模型(学生模型)来模仿一个较大的、预训练好的模型(教师模型)的行为。这样,学生模型可以学习到教师模型的知识,同时保持较小的尺寸。

4、模型架构搜索(Model Architecture Search, MAS)

MAS 涉及自动搜索和优化神经网络的架构,以在保持性能的同时尽量减少模型的大小和计算成本。

5、权重共享和编码

通过共享权重或对权重进行编码,可以进一步压缩模型。这些方法通过减少需要存储的参数数量来工作。

6、使用高效的模型架构

选择本身就设计为高效的模型架构,例如MobileNet、ShuffleNet等,这些模型在设计时就考虑到了计算效率和模型大小。

7、压缩库和工具

使用特定的库和工具,如TensorFlow Lite、TensorFlow Model Optimization Toolkit、PyTorch的量化工具等,可以帮助进行模型的压缩和优化。

8、软件打包优化

对于非模型本身的AI安装包(如包含模型、代码和相关依赖的软件包),可以采用软件打包技术如:

Docker容器化:将应用及其依赖打包成一个容器,可以确保在不同环境中一致运行,并减少环境依赖问题。

使用包管理器:如pip、conda等,它们可以有效地管理依赖并压缩包大小。

实际操作步骤:

1、选择合适的方法:根据你的具体需求和场景,选择最合适的压缩方法。

2、评估压缩效果:在压缩过程中和压缩后,评估模型的性能,确保压缩后模型仍能满足应用需求。

3、自动化和脚本化:使用脚本和自动化工具可以简化压缩和优化的过程。

压缩AI安装包可以有效减少存储和传输成本,提高模型部署的效率,但需要根据具体的应用场景和模型类型选择合适的方法。

0

IP地址: 91.134.143.60

搜索次数: 2

提问时间: 2025-04-19 23:30:37

热门提问:

柴达木发现大型金矿

汇添富中证互联网医疗指数(LOF)C

汇丰外汇金融

详细介绍域名68.hk的含义、价值与适合的行业。

ai泳装性感美女

作曲的ai工具

详细介绍域名www.su7.cab的含义、价值与适合的行业。

ai选股免费

嘉麟杰

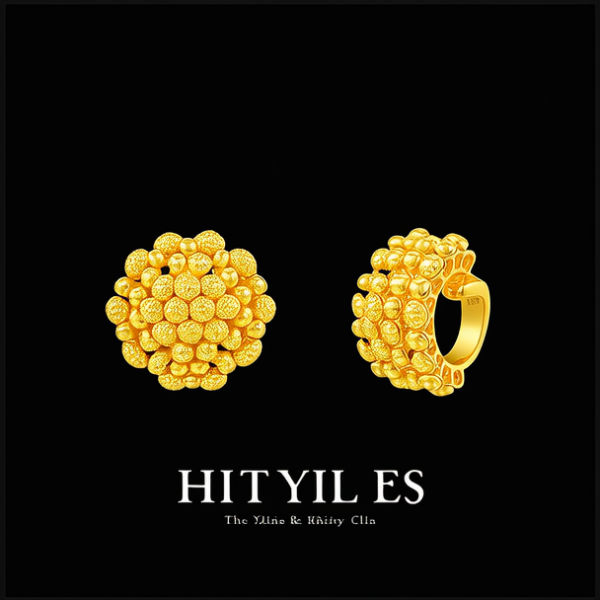

80克黄金首饰多少钱

豌豆Ai站群搜索引擎系统

关于我们:

三乐Ai

作文批改

英语分析

在线翻译

拍照识图

Ai提问

英语培训

本站流量

联系我们

温馨提示:本站所有问答由Ai自动创作,内容仅供参考,若有误差请用“联系”里面信息通知我们人工修改或删除。

技术支持:本站由豌豆Ai提供技术支持,使用的最新版:《豌豆Ai站群搜索引擎系统 V.25.05.20》搭建本站。