🗣 SL提问: kimi ai论文

✍️ Ai批改: 截至2023年,关于“Kimi AI”的具体学术论文尚未在公开的学术数据库(如 arXiv、PubMed、IEEE Xplore 或 ACM Digital Library)中找到。Kimi AI 是一款由月之暗面开发的开源大语言模型,其技术细节和研究成果可能尚未以正式论文的形式发布。

不过,如果您对类似的大规模语言模型感兴趣,可以参考以下相关领域的经典论文或研究方向:

1、Transformer 模型

Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A、N., Kaiser, Ł., & Polosukhin, I、(2017)、[Attention Is All You Need](https://arxiv.org/abs/1706.03762)、*Advances in Neural Information Processing Systems*.

这篇论文介绍了 Transformer 架构,它是许多现代大型语言模型的基础。

2、大规模语言模型

Brown, T、B., Mann, B., Ryder, N., Subbiah, M., Kaplan, J., Dhariwal, P., Neelakantan, A., Shyam, P., Sastry, G., Askell, A., Agarwal, S., McGrew, B., Chen, I、J., Gray, S., Bhagat, J., Radford, A., & Sutskever, I、(2020)、[Language Models Are Few-Shot Learners](https://arxiv.org/abs/2005.14165)、*arXiv preprint*.

这篇论文描述了 GPT-3 的设计和性能,是研究大规模语言模型的重要参考。

3、开源大模型

Zhai, F., Liu, C., Wu, J., & Wang, W、(2021)、[OpenCLIP: CLIP Pretraining with Open-Domain Web Images](https://arxiv.org/abs/2103.00020)、*arXiv preprint*.

这篇论文展示了如何通过开源数据训练强大的多模态模型。

4、中文语言模型

Sun, Q., Xu, J., Zhou, M., & Zhao, T、(2022)、[StructBERT: Incorporating Language Structures into Pre-training for Deep Language Understanding](https://aclanthology.org/P19-1220/)、*Proceedings of the 57th Annual Meeting of the Association for Computational Linguistics*.

StructBERT 是一个针对中文语言理解的预训练模型。

如果您需要更详细的信息或有特定的研究需求,请提供更多信息,我将尽力为您提供帮助!

0

IP地址: 105.148.173.164

搜索次数: 14

提问时间: 2025-04-26 04:21:56

❓️ 热门提问:

15克黄金大概多大

永久免费域名注册平台

黄金乾坤圈吊坠

0.01克黄金等于多少克

南方中证港股通汽车产业主题指数

黄金回收上门收金

银华季季丰90天滚动持有债券C

tr外汇越来越火了

富拓外汇网站下载

国内炒黄金哪个平台好

豌豆Ai站群搜索引擎系统

🤝 关于我们:

三乐Ai

作文批改

英语分析

在线翻译

拍照识图

Ai提问

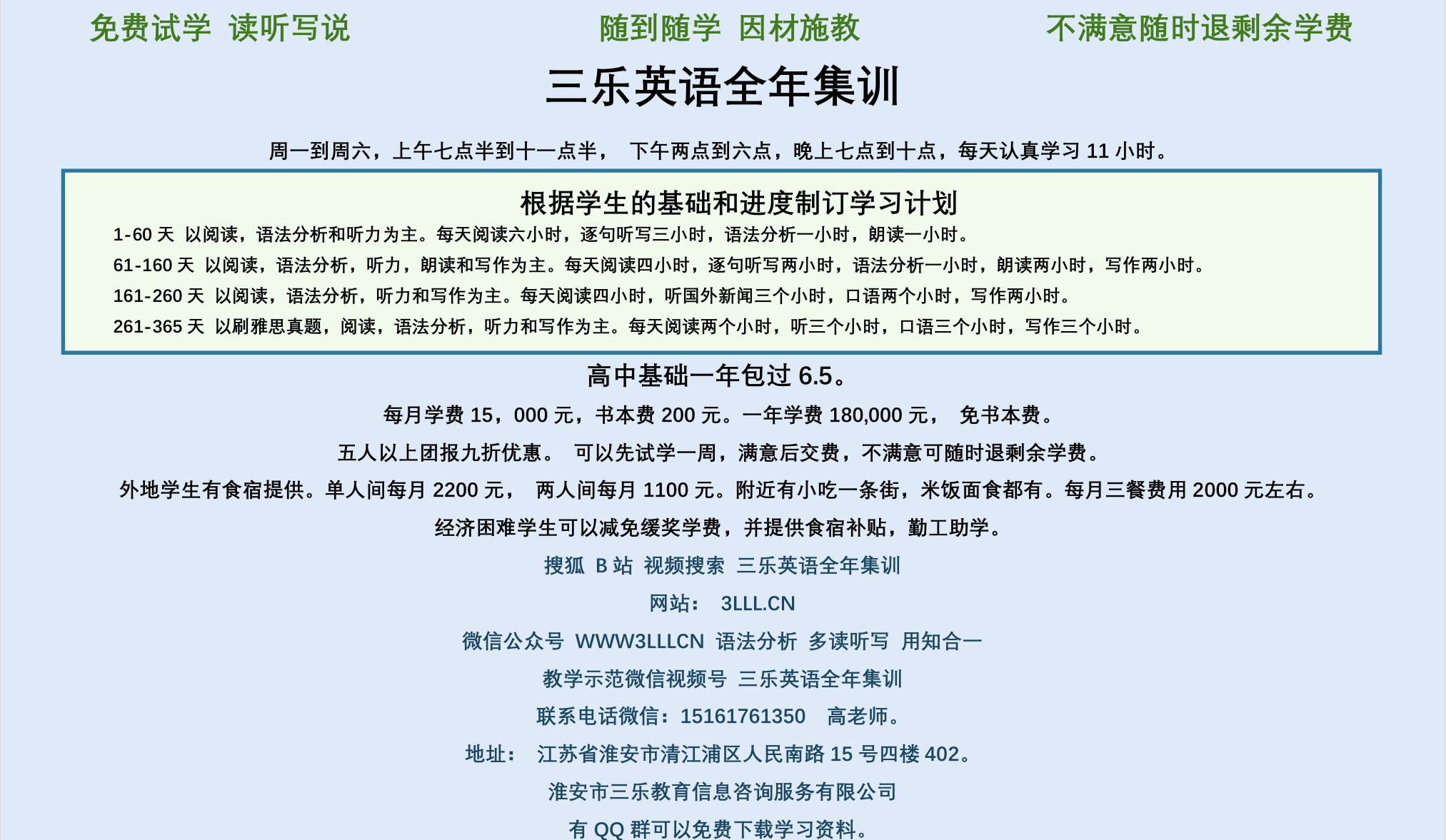

英语培训

本站流量

联系我们

📢 温馨提示:本站所有问答由Ai自动创作,内容仅供参考,若有误差请用“联系”里面信息通知我们人工修改或删除。

👉 技术支持:本站由豌豆Ai提供技术支持,使用的最新版:《豌豆Ai站群搜索引擎系统 V.25.05.20》搭建本站。